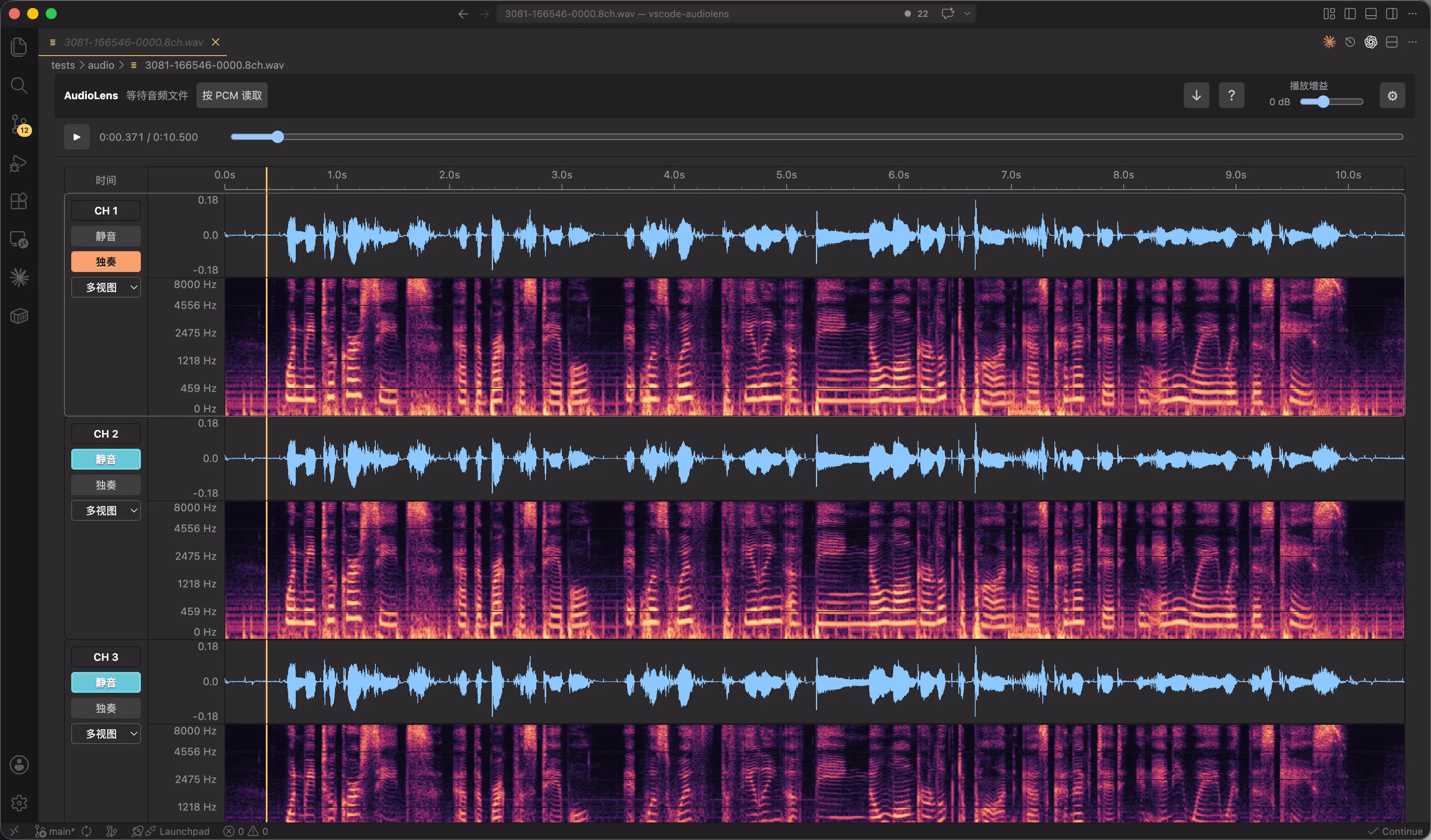

介绍 AudioLens:一个把 VS Code 变成音频分析工作站的插件

本文介绍 AudioLens,一个全新的,尝试在 VS Code / Cursor / Trae 中复刻 Audacity / Audition 的最佳体验,用于播放、分析、观察音频文件的插件。

针对语音、声音事件检测、音频算法、信号处理、机器学习或音频数据集处理工作者,日常工作流的一个痛点问题是:

代码在编辑器里,数据清单文件在编辑器里,日志也在编辑器里,但音频一旦要听、要看波形、要查频谱,就不得不切到播放器、Audacity、文件管理器等工具。如果是 Remote SSH 工作,那么甚至更复杂,需要先将音频通过 SFTP 等工具拷贝到本地再打开。

AudioLens 想解决的就是这个问题:让音频工程相关的查看、播放和轻量分析,都尽量留在编辑器里完成。