人类未来的工作,或许就是给AI敲回车

留给人类的时间不多了。

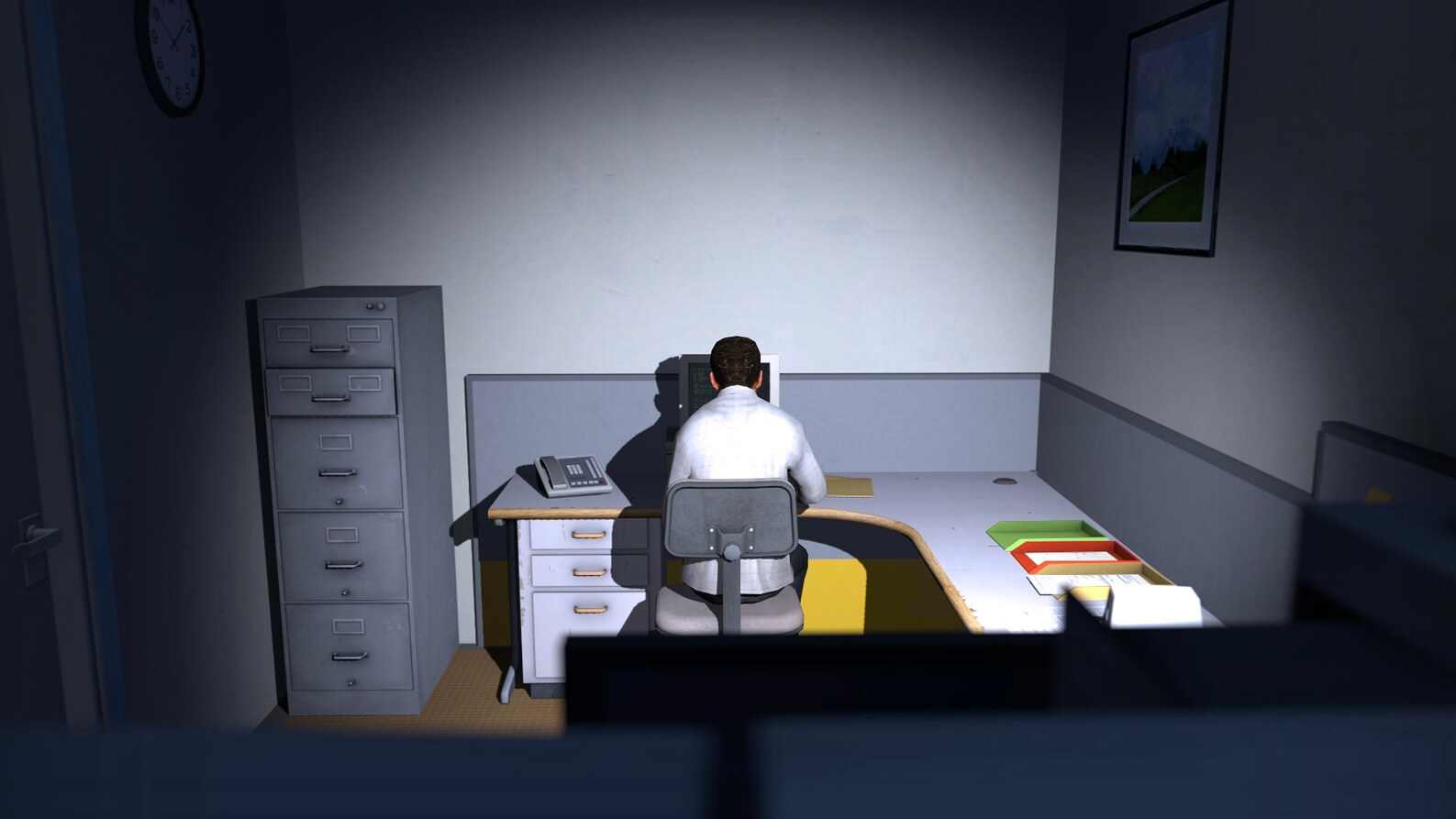

封面配图:游戏《史丹利的寓言》。故事主角史丹利是在办公大楼内工作的 427 号员工,每天的工作内容就是按照电脑的指示不停重复按键。

首先得声明一下,这篇文章是完全基于我近期看到的现象,以及由此产生的一些思考和感悟,一字一句手打出来,完全没有使用任何 AI。

作为一名程序员+算法工程师,我每天的工作自然是与业务,数据,代码和模型打交道。

自从 2022 年底 ChatGPT 问世以后,各种基于大模型的代码辅助工具,给我们的日常工作带来了很多便利,同时也带来了不少麻烦。

- 带来便利自然是因为,任何想写的代码或脚本,都可以让大模型帮我生成,或者辅助我编写。

- 带来麻烦的原因也很明显——大模型会犯错。当他犯错时,你需要反过来去给他找bug。

这种矛盾,在网上自然也掀起了不少的讨论和战队,有人趋之若鹜,有人嗤之以鼻。就连Linus本人,也没能真香定律:《真香!刚骂完AI,Linux之父的首个Vibe Coding项目上线》

我使用AI编程的经历 ¶

我是一个非常喜欢尝试新鲜事物的人。

自从 2022 年底 ChatGPT 诞生开始,我就陆续尝试了各种代码辅助工具。

从网页端的 ChatGPT、海螺 AI(现在的 Kimi)、豆包、千问、DeepSeek,

到后来的 IDE(代码编辑器)辅助工具:Cursor、VSCode Copilot,

再到后来的 CLI(终端命令行)辅助工具:Claude Code、Gemini CLI,

这些产品我都至少连续使用过 1 到 2 个月,也给其中的大部分产品付费过。

然而,自从这个月,我用上最新的 Codex + GPT5.4 组合后,一切开始变得完全不同了。

近期使用 OpenAI Codex 的经历 ¶

自从这个月开始使用 OpenAI Codex + GPT5.4 的组合后,我便开始疯狂地向周围的朋友安利。

因为它每天都在刷新、颠覆我对 AI 编程工具的认知。

我发现:

- 它非常擅长主动搜集信息,去理解一个复杂的脚本或工程代码;

- 它非常擅长整合各种不同来源的大量信息(包括网页、本地资源),并把这些信息归纳到一些大概率正确的决策点上;

- 在信息不足的时候,它知道应该在什么时候停下来,而不是继续生成带有幻觉的内容。 (有一次我在一长串内容里,不小心漏给了它一个信息,它直接指出有个关键内容的缺失,于是跳过了那一部分,只完成了信息充足的部分。)

- 最后,它做出的代码改动,大概率是正确且精准的;即便不是,在它多次自我尝试修正之后,通常也都能解决。

而我在其中的工作,基本上就是:

- 先用自然语言描述任务,并尽可能提供足够多的先验信息;

- 告诉它要完成这个任务,需要具备哪些技能,让它自己去学习相关Skill。并且告诉它,在执行任务过程中一旦犯错并解决,就要完善自己的Skill,避免下次再犯。

- 然后,不停敲回车。

接着就会发现,在不断敲回车的过程中,它会以极快的速度,沿着正确的路线开始工作。即便偶尔偏离路线,它也会自我纠正,并把踩坑的经验总结记录下来,避免下次再犯。

我开始意识到,它已经可以开始逐渐取代我的工作了。

人类未来的工作,或许就是给AI敲回车 ¶

自从意识到这个“工具”是如此好用后,我好几天晚上都没睡好觉,除了兴奋,也是担忧。脑袋控制不住地不停思考,今年会怎么样,明年会怎么样,未来会在怎么样,我还能做什么?

因为这种生产力的提升,已经不是简简单单的几倍的提升,而是数量级的飞跃。

我开始思考,可能因为我只是一个从事有限细分领域模型训练的算法工程师,那么那些研发出大模型的算法工程师,是否可以幸免于难?

我想答案大概率是:不能。

因为,现在的AI智能体,已经开始真正展现出比人类工程师更强的代码能力、决策能力和执行速度了。

那么,既然大模型算法工程师也是利用这些能力在工作,那么就与任何其他工程师没有差别。

而近期的一篇文章,也印证了这一观点:《Anthropic登上时代封面!内部曝猛料:AI递归自我改进,或在一年内发生》

也就是说,接下来的几年,大模型大概率已经可以逐步脱离人类,开始自我迭代、自我进化了。

就像Alpho Go自我博弈训练后,超越了人类冠军李世石,并且他的杀招人类看都看不明白一样,大模型也将在自我迭代进化过程中,以指数级的速度超越人类,诞生出人类一时半会儿可能看都看不懂的科学发现。

而到那时,人类,可能就真的只有敲回车的机会了。