人類の未来の仕事は、AI のために Enter キーを押すことになるかもしれない

人間に残された時間は、もうあまり多くないのかもしれない。

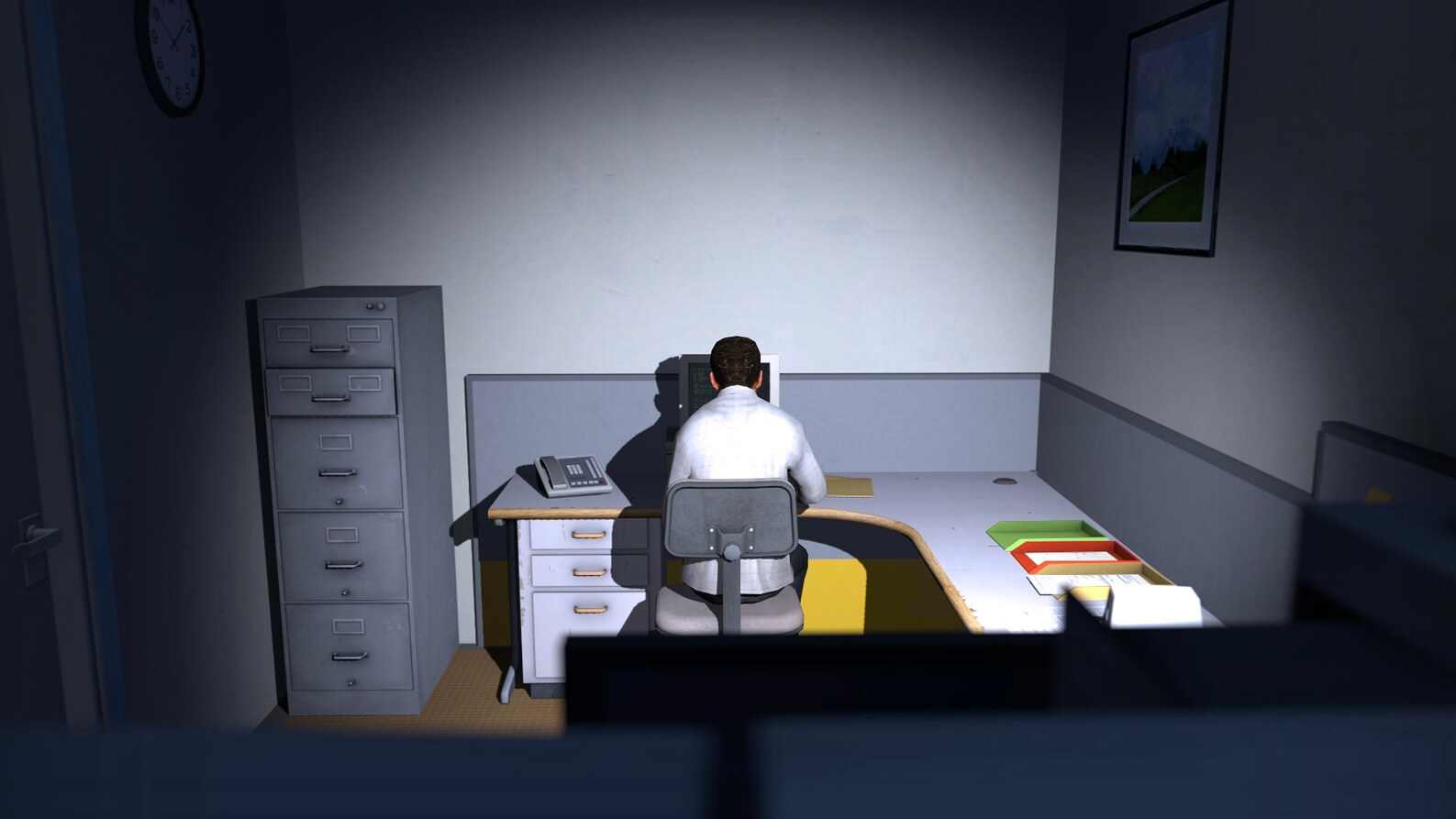

カバー画像: The Stanley Parable。主人公スタンリーはオフィスビルの Employee 427 であり、彼の日々の仕事はコンピュータの指示どおりにひたすらキーを押し続けることだった。

まず 1 つはっきりさせておきたい。この文章は、ここ最近私が観察してきた現象と、そこから生まれた考えや感想だけをもとに書いている。すべての文は手で打ち込んだものであり、この記事の執筆には AI を一切使っていない。

プログラマであり機械学習エンジニアでもある私の仕事は、当然ながら日々、業務ロジック、データ、コード、モデルを中心に回っている。

2022 年末に ChatGPT が登場して以来、大規模モデルをベースにしたさまざまなコーディング支援ツールは、日常の仕事に大きな便利さをもたらした一方で、かなりの面倒も持ち込んだ。

- 便利さは明白だ。書きたいコードやスクリプトのほとんどは、大規模モデルに生成させたり補助させたりできる。

- 面倒な点もまた明白だ。大規模モデルは間違える。 そして間違えたときには、その AI が書いたコード をこちらがデバッグしに戻らなければならないことが多い。

この矛盾はネット上で数え切れないほどの議論を生んできた。熱狂的に受け入れる人もいれば、最初から切って捨てる人もいる。あの Linus ですら、最後にはお決まりの「考えを変えた」側に回った。

「AI を批判していた Linux の生みの親、ついに最初の Vibe Coding プロジェクトを始める」

AI を使ったプログラミングに関する私の経験 ¶

私は新しいものを試すのが好きな人間だ。

2022 年末に ChatGPT が登場して以来、いろいろな AI コーディングツールを試してきた。

ChatGPT、Hailuo AI(今の Kimi)、Doubao、Qwen、DeepSeek のような Web ベースのアシスタントから、

Cursor や VSCode Copilot のような IDE ベースの支援ツール、

さらにその後の Claude Code や Gemini CLI のような CLI ベースのツールまで。

これらのツールはどれも、少なくとも 1 か月から 2 か月は継続的に使ったし、その多くには実際に課金もしてきた。

しかし、今月 Codex + GPT-5.4 という組み合わせを使い始めてから、すべてが変わった。

最近の OpenAI Codex 体験 ¶

今月 Codex + GPT-5.4 の組み合わせを使い始めてから、私はかなり熱心にこれを友人たちに勧めている。

なぜなら、それは AI コーディングツールに対する私の理解を何度も更新し、ひっくり返し続けているからだ。

私はいくつかのことに気づいた。

- 複雑なスクリプトやコードベースを理解するために、自分から積極的に情報を集めるのがとてもうまい。

- Web 上の情報とローカルファイルを含む、異なるソースから大量の情報を統合し、かなり高い確率で正しい判断ポイントへ要約するのが得意だ。

- 情報が不足しているとき、そこで止まるべきタイミング を分かっている。ハルシネーションで埋めようとしない。

(一度、長いコンテキストの中でうっかり重要な情報を入れ忘れたことがあった。すると Codex は欠けている情報をそのまま指摘し、その部分は飛ばして、十分な情報がある部分だけを完成させた。) - 最後に、加えるコード変更が かなり高い確率で正確かつ的確 だ。最初から完全に当たらなくても、何度か自己修正を試みるうちに、たいてい問題を直してしまう。

この過程での私の役割は、ほとんど次のようなものだ。

- まず自然言語でタスクを説明し、事前情報をできるだけ多く渡す。

- 必要な skill を教え、それを自分で学ばせ、間違いを直したときには同じ失敗を繰り返さないよう skill も更新するよう伝える。

- そして Enter を押し続ける。

そうして Enter を押し続けていると、信じられない速度で正しい方向へ進んでいくのが見える。途中で少し逸れても、すぐに自分で修正し、その失敗から得た教訓を記録して次回に生かしていく。

ある時点から、私は次のように感じ始めた。

これは、いずれ私の仕事を置き換え始めるのではないか。

人類の未来の仕事は、AI のために Enter キーを押すことになるかもしれない ¶

この「道具」がどれほど強力なのかを実感してから、私は何晩かろくに眠れなかった。

興奮もあった。だが同時に、不安もあった。

今年はどうなるのか。来年はどうなるのか。未来はどんな姿になるのか。自分には何がまだできるのか。そんなことが頭の中を延々と回り続けた。

なぜなら、これは単に数倍の生産性向上ではない。桁がひとつ違う跳躍だからだ。

私は考え始めた。自分はたまたまモデル学習という比較的狭い分野で働くアルゴリズムエンジニアにすぎない。では、大規模モデルそのものを作っている人たちはまだ安全なのだろうか。

私の答えは、おそらくノーだ。

なぜなら、AI エージェントはすでに 人間のエンジニアより強いコーディング能力、意思決定能力、実行速度 を見せ始めているからだ。

もし大規模モデルのエンジニアも、結局はそうした能力に依存して仕事をしているのなら、本質的には他のエンジニアと変わらない。

最近出たある記事も、この見方を裏づけているように思える。

「Anthropic が TIME 誌の表紙に。内部情報によれば、AI の再帰的自己改善は 1 年以内に起きる可能性がある」

つまり、今後数年のうちに、大規模モデルは徐々に人間の誘導から離れ、自分で反復し、進化し始めるかもしれない。

AlphaGo が自己対戦を通じて人間の名手である李世乭を超え、ときに人間には理解しにくい打ち筋を編み出したように、大規模モデルもまた指数関数的な自己改善によって人間を超えていく可能性がある。

それらは、人間には少なくとも最初のうちは理解しにくい科学的発見すら生み出すかもしれない。

そしてそのとき、人類に残る役割は本当にただひとつになるのかもしれない。

Enter を押すこと。